臉書表示,他們並未限制每個決定須在多少時間內完成。然而記者報導及深入研究審核流程的幾位學者都指出,如果仔細考慮每則內容去留,大概保不住這份低薪工作。

我訪談的一位審核員似乎正在挑戰這個非明文規定的審核則數:他的個人目標是一天判斷200則。「速度太快,你會錯過小細節。」他表示。如果被質疑工作產出,他希望自己的高準確率可以彌補平均較長的處理時間。

出錯數量有多少?很難說,但可以參考的指標是用戶申訴成功的次數增加。2019年前三個月,臉書共移除1,940萬則內容,其中用戶上訴210萬次,近四分之一申訴成功,也就是最初的判斷有錯;另外有66.8萬則移除內容未經申訴就恢復了。換句話說,雖然多數時候判斷正確,仍有數百萬用戶因審核員分秒必爭的壓力受到影響。

一套原則適用全球?

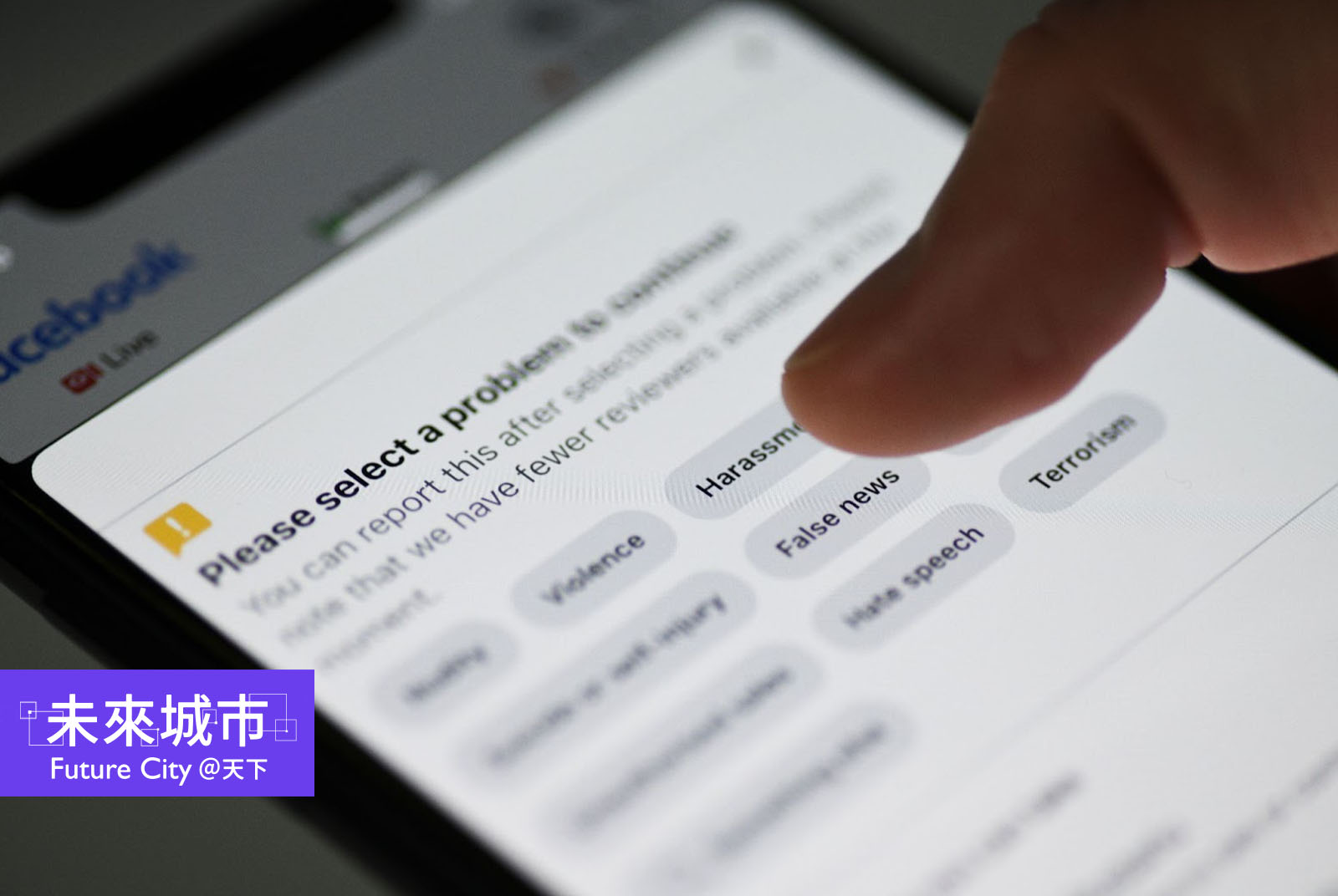

審核員需確認有問題的內容違反哪條規範,臉書的規範從早期的一頁文件不斷擴充,最後變成「社群守則」。指南的部分內容被多次外流,後來臉書乾脆在2018年完整公開。

臉書社群守則證明了這份工作有多困難。一套原則要適用全球各地,無法顧及文化差異,而且涵蓋臉書所有的應用,包括動態消息、Instagram、個人檔案頁面,以及WhatsApp與Messenger的私人訊息。這些規定有的直接了當,有的則模稜兩可,讓審核員無所適從。

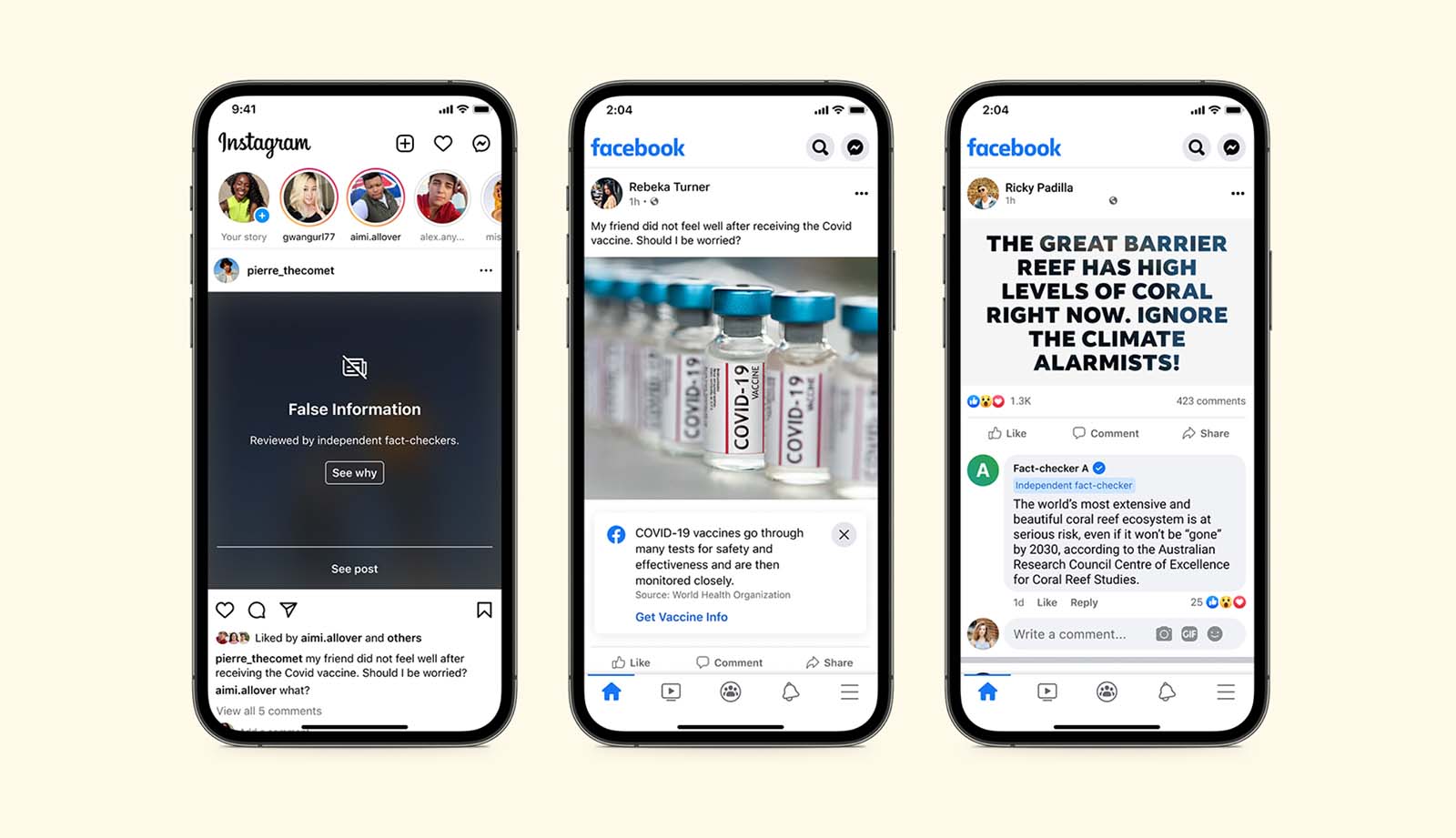

臉書試圖定義相同主題下不同程度的嚴重性,例如某些類型的身體暴露沒關係,其他則需要「插入式警語」,類似電視節目開始前螢幕上會出現的提醒畫面——「以下畫面可能出現臀部」。血腥畫面不行、大屠殺則需靠主觀判斷才能正確歸類。

臉書以插入式警語、標籤等機制,提醒用戶注意敏感資訊。圖片來源:截自Meta網站

臉書以插入式警語、標籤等機制,提醒用戶注意敏感資訊。圖片來源:截自Meta網站

「如果倒帶回臉書很早期,我想很多人不知道我們是整個團隊在辯論,如何定義裸露、什麼是圖像化的暴力呈現,有非常多超級細節的東西。」誠信團隊的羅森表示,「這是肉眼可見的內臟嗎?還是燒焦的屍體?」

27頁的文件不可能納入每個例子,因此臉書建立了大量不對外公開的補充文件,探討特定案例。

《紐約時報》記者表示,他搜集了1,400頁此類文件。科技網站「主機板」取得臉書外流的內部訓練文件,上面有各種難堪的畫面,例如肛門被合成到泰勒絲(Taylor Swift)雙眼的位置。

訓練投影片上寫著,這種惡作劇可被允許,因為泰勒絲是名人,但對同學這麼做就算是霸凌,不被允許。儘管如此,有一張照片是金正恩的嘴巴被換成肛門,還塞著性愛玩具,那張照片就被移除了。

如何分級仇恨?

仇恨言論最難判斷。臉書不容許仇恨言論,但低估了精確定義仇恨言論的難度。

臉書全球政策管理長畢克特(Monika Bickert)表示:「仇恨言論是我們最難執行的政策,因為缺乏上下文脈絡。」同樣幾個字,用來和好友開玩笑跟用在無辜陌生人身上,就非常不同。

畢克特和團隊了解,「男人都該死」跟「猶太人都該死」完全不同,但他們認為如果要區分誰是弱勢、誰是特權團體,又會過於複雜。

舉例來說,假設有臉書用戶提到某位名人說了種族歧視的話,如果他寫的是:「某名人說了這句話,太離譜了吧?」這樣的文章臉書會放行,因為這算是協助人們評估該名人性格的資訊。

然而,如果用戶引用同一句話,但寫的是:「這就是為什麼我喜歡這傢伙!」臉書將移除那則訊息,理由是用戶表示認同種族歧視。「然而,如果我只是引用那句種族歧視的話,接著說那是『某名人說的』呢?」畢克特表示,「我是認同那位名人講的那句話,還是在譴責他?意思並不清楚。」

仇恨言論太複雜,臉書不得不分級。第一級包含說男人是人渣,以及比喻某個族群是細菌、性侵犯,或是「在文化中被視為智力或體能較為低等的動物」。第二級是具備次等意涵的侮辱,例如說某人/某群體精神有問題或沒用。第三級是政治或文化侮辱,例如呼籲種族隔離、表達種族歧視,或直接辱罵。處罰依據情節輕重而定。

臉書定期與全球各分部人員開會,討論社群貼文的審核標準。圖片來源:截自Meta網站

臉書定期與全球各分部人員開會,討論社群貼文的審核標準。圖片來源:截自Meta網站

我在2018年參加臉書的「內容標準論壇」會議,仇恨言論是其中一個討論主題。畢克特每兩週都會開這場會,討論規則變動。會議室裡大約有20人,還跟都柏林、華府,及全球臉書各分部視訊連線。

這次會議談到與「男人都很渣」類似的仇恨言論議題。現場討論的問題是痛恨「優勢族群」(例如:男性、億萬富翁)的意見,是否該嚴格處置,視為和誹謗「受保護的族群」(性別、種族)一樣嚴重。

結論很有趣:報告指出最理想的結果,是採取「另當別論」的做法,允許人們發洩對優勢族群的怨氣。但這樣的做法被否決了,因為要下這樣的判斷對審核員來說太過複雜。(延伸閱讀|為何PTT上的假訊息比FB易被發現?杜奕瑾分析演算法差異給你看)

臉書為何總是誤判?

臉書定期檢視審核員下的判斷,錯誤數量過高時會做事後檢討。但公司提供給審核員的時間與薪水都不足,經常出錯是必然的。一位臉書前審核員曾告訴我:「如果每個人一天只需要檢視一件事,我們應該不會漏掉東西。」

臉書陷入關鍵的兩難:臉書不斷雇用審核員,但審核員必須看的內容數量依舊驚人,不得不以超快速看每一則,難免會出錯。

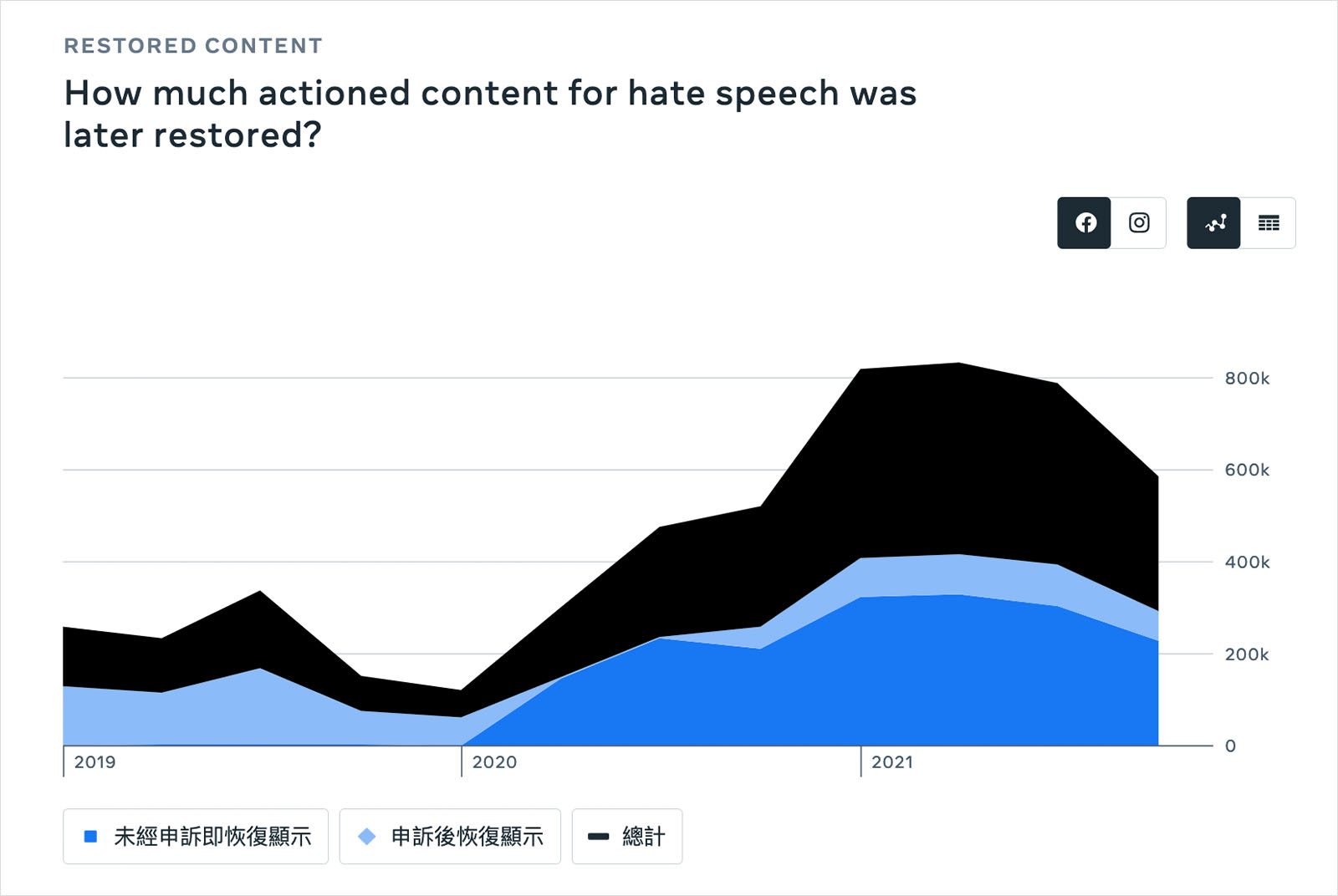

2020年開始,臉書仇恨言論貼文遭誤判後,恢復顯示的數量大幅增加。圖片來源:截自Meta網站

2020年開始,臉書仇恨言論貼文遭誤判後,恢復顯示的數量大幅增加。圖片來源:截自Meta網站

當用戶的照片被錯誤移除,會上社群媒體抱怨;要是用戶檢舉別人的內容,但該內容沒被下架,也會抱怨。媒體也虎視眈眈,隨便就能找到類似證據,指出臉書誤判了很糟糕的事。

但實情大概只是內容審核員過勞,可能還有心理創傷。祖克柏也知道這件事,他表示:「我們見報的事,十次有九次不是因為我們定下大家不同意的政策,而是處理時不小心搞砸。」

儘管有時間壓力,儘管每天要看人性最糟的一面,我訪談的人表示幫臉書做審查工作並不糟。他們是第一線的應變人員,把自己視為無名英雄,保護數十億臉書用戶不受傷害。

「我碰過曾經拯救人命的審查員,有用戶試圖自殺,他們向執法單位通報。」臉書負責管理審核工作的詹德拉(Arun Chandra)表示,「這份工作帶來的滿意度與成就感算是意外的驚喜。」(延伸閱讀|為何不該在臉書上按讚?哈佛教授:按了之後,你只會看見這3種文章⋯⋯)

作者:史蒂芬.李維(Steven Levy) 出版社:天下雜誌 出版日期:2022/01/03