本文摘要

如何讓人工智慧看到人眼無法看到的細微之處?細密識別為動植物保育和社會科學研究帶來許多好處,讓視覺成為鏡頭了解世界。斯特魯普測試和變化盲點告訴我們,人類無法看到的東西,通常只是因為不在我們的注意範圍內或差異太微小。但在現實生活中,這可能產生嚴重後果,如醫療疏失成為第三大死因。因此,人工智慧用於追蹤手術器械等細節變得越來越重要。

本文探討了人工智慧在醫療、男女性別偏見等方面的應用問題,以及隱私保護的重要性。李飛飛分享了實驗室的研究,做出了一種透鏡,可以透過扭曲畫面的方式保護隱私,在進行電腦視覺時,尊重隱私是非常重要的。揭示AI帶來深刻影響的同時,我們也需要致力於多學科研究和探索AI的正確使用方式。(ChatGPT整理)

現在,讓我們來談一個更微妙、更有趣的問題:如何建立人工智慧,來看到人類看不到的東西?

這是什麼意思呢?(投影片為一個正在玩恐龍玩具的小孩)對這個孩子來說,他可能認識20或30種不同的恐龍,而我只認識兩種。

結果發現,ImageNet捕捉到的2.2萬個類別並不足以描述我們的視覺世界。我們的視覺世界更精細。例如,世界上有超過一萬種鳥類,但我可能只能識別出五種。汽車也是一樣。1970年代後,已經製造了超過3,000至4,000個汽車型號。我們可能能夠辨認出豐田和特斯拉,「1998年豐田喜美」又是一個潛在類別,我們稱之為「細粒度類別」(fine-grained category)。

雖然人類不擅長識別物體的細類,但讓機器能夠辨識其實很重要。在動植物保育有許多應用。

幫醫師找出遺漏海綿的「細粒度識別」演算法

這種細密識別為某些事帶來很多好處。以汽車為例,我們利用這種方法對美國進行社會科學研究, 研究美國的人口統計。實際上,我們將車型與投票模式、教育水平、收入等相關性進行分析。視覺和看到人們通常看不見的能力成為了解世界的一個鏡頭,這令人著迷。

我現在對你們做一個「斯特魯普測試」(Stroop):不要念出你看到的單字,而是念出該單詞的顏色,從左到右。並且唸得盡可能快。這真的很難,對吧?

我再給你們看兩張交替的圖片。你可能會認為它們一樣,但如果你發現了兩張圖片之間的差異,請舉手。(兩張飛機照片的引擎不同)

從像素的角度來看,引擎有很多像素,它不是一個小東西,但是我們卻沒有注意到。這種現象稱爲「變化盲點」。

斯特魯普測試與變化盲點測試都告訴我們,人類有時候看不到很多事情,是因為它們只是不在我們的注意範圍內,又或者他們之間的差異太微小。

把視覺當作遊戲很有趣,但如果因此付出生命代價,就不好玩了。

在現實生活中看不到東西可能會帶來嚴重後果。在美國醫療系統中,醫療疏失是繼癌症和心臟病後的第三大死因。

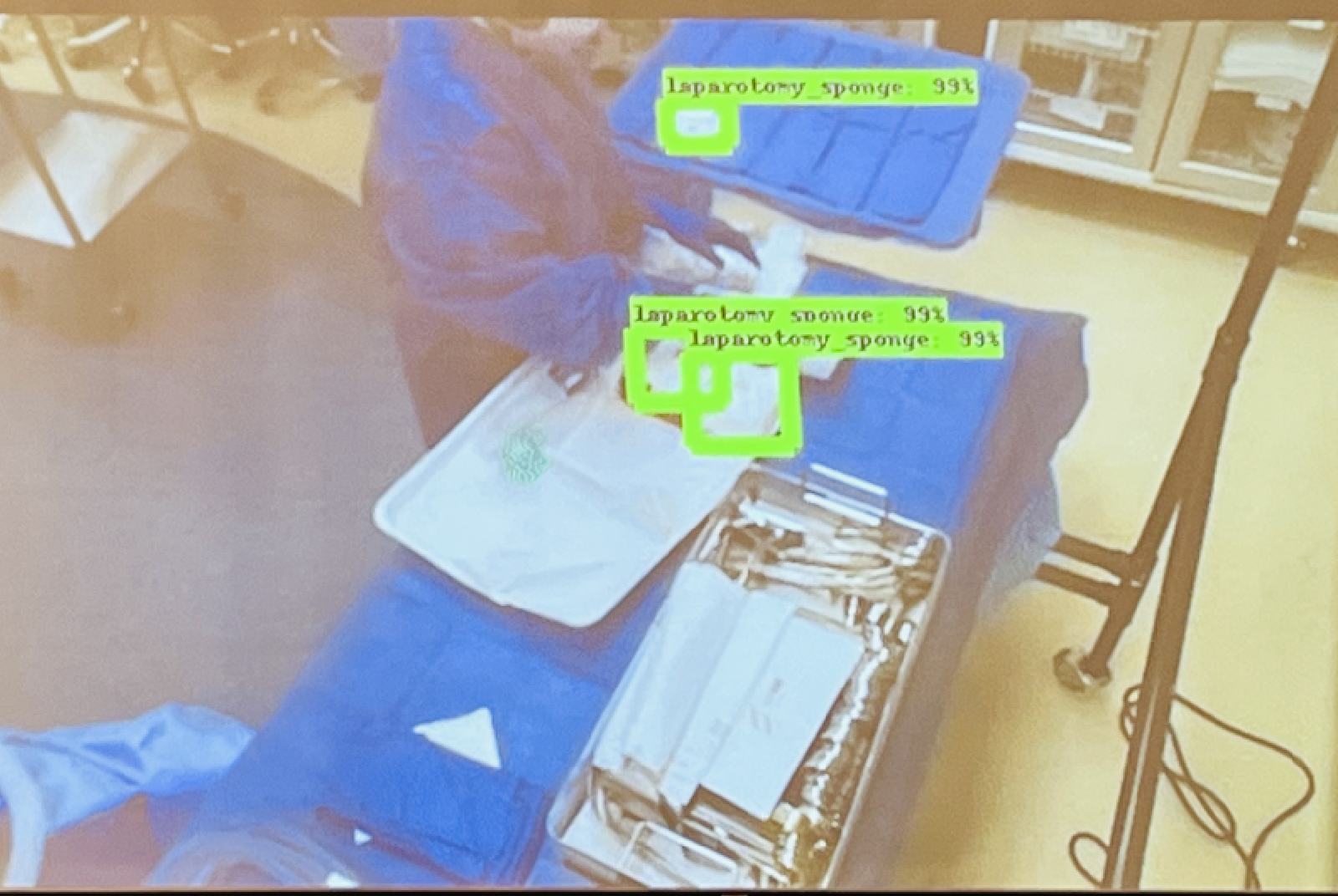

以下是一個例子。手術期間使用的醫療設備若留在病人體內,可能會致命。那麼,我們該如何追蹤它呢?現在,我們通過人工接觸來追蹤的。(簡報為AI標註手術中的器械)

如果我們在病人體內丟了一個海綿或一個小縫合針,會發生什麼事呢?在醫療過程中,我們必須暫停手術,開始記錄它們,暫時讓病人的傷口打開長達幾個小時。

因此,電腦視覺可作為一種工具。我們正在與史丹佛醫學院合作訓練細粒度識別演算法,以幫助醫生追蹤物件,尤其是在手術期間追蹤小物件。(簡報為在手術過程中追蹤海綿)。(延伸閱讀|放心,AI不會使醫師失業!醫院CIO都在忙什麼?)

在手術台上,AI可幫助醫療人員追蹤開刀工具,以免遺漏在病人體中。圖片來源:陳芳毓攝

在手術台上,AI可幫助醫療人員追蹤開刀工具,以免遺漏在病人體中。圖片來源:陳芳毓攝

Joy Buolamwini是一位知名的年輕電腦科學家和詩人,她寫了一首詩歌,探討人臉識別中偏見的問題,尤其是在識別有色人種和女性有色人種的臉孔時。解決這些問題非常重要。

人工智慧可以放大人類的偏見,有時也可以揭示人類的偏見。

其中一個例子是Google的一項研究,使用人臉識別算法和語音識別算法檢測男演員和女演員在螢幕時間上的偏見。這個研究使用了大數據和人工智慧,發現男演員比女演員獲得更多的螢幕時間。

安全與隱私的平衡:如何讓AI「視而不見」?

在以上部分,是說明我們正試圖使用人工智慧看人類看不到的東西。然而,有時「忽視」某些事情也非常重要——這讓我們談到隱私問題,特別是醫療保健領域,我們用智慧攝影機來保護病人的安全,但同時也面臨隱私問題。因此,即使是為了保護病人安全,也必須有防護措施和限制。

即使隱私問題涉及的不僅是技術性,但還是有一些技術解決方案。例如使用模糊技術、降維技術、差分隱私技術、聯邦學習技術或加密技術來保護和打擊隱私侵犯的問題。(延伸閱讀|全民健保資料可做學術利用嗎?國內爭議與國外趨勢分析)

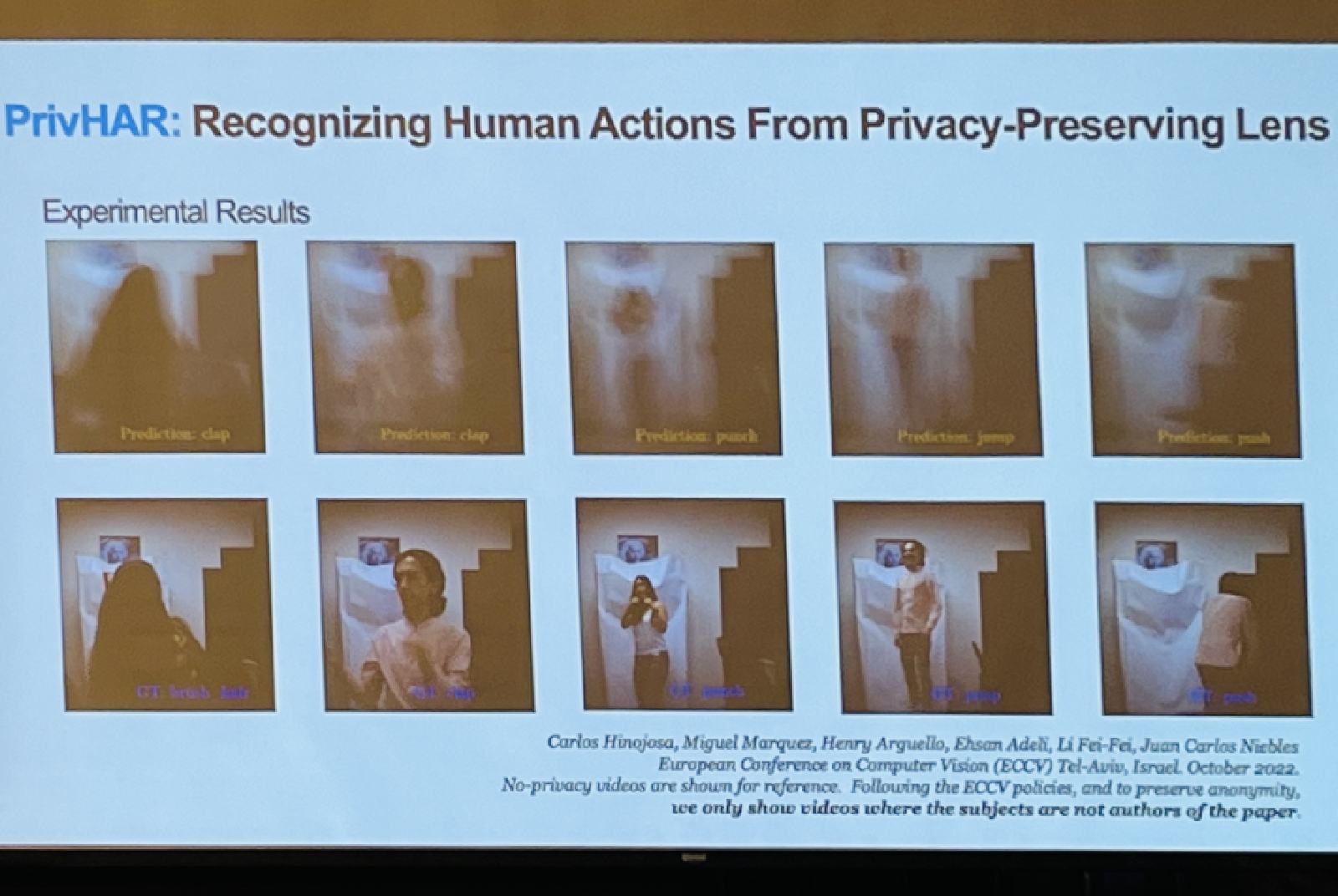

與大家分享我實驗室的研究,由年輕科學家Juan Carlos Niebles和他的學生完成。

他們不僅發展出一種演算法來保護隱私,還開發了一種鏡頭。他們正在嘗試開發一個電腦視覺演算法,以識別人類的動作。

這非常重要,觀察游泳池溺水的可能或兒童遊樂場的安全,同時又要保護隱私,你要怎麼做呢?

他們創造了一種透鏡,畫面可以扭曲,透過透鏡拍到的訊號不會透露人們的身份,但是使用與該訊號相關的算法,卻能識別人類的手勢。這是一種非常聰明的軟硬體結合,可以透過尊重隱私來進行電腦視覺,我很喜歡這項專案,也看到很多商業用途。

科學家研發一款電腦視覺演算法,可兼顧AI偵測與人類隱私權。圖片來源:陳芳毓攝

科學家研發一款電腦視覺演算法,可兼顧AI偵測與人類隱私權。圖片來源:陳芳毓攝

這個部分的重點是,我們正在開發AI,以看到人類看不到的事物。AI也能放大或加劇偏見、隱私等,這些問題困擾人類已久,我們必須致力於多學科研究,預測並指引AI對人們和社會的影響。

繼續閱讀:李飛飛2023來台演講全記錄