如果你想一窺電腦和人類關係的現況與未來,有一個好方法:觀察目前人類和數位同伴的一些對話。全世界現在已有幾百萬人和Cortana 這樣的數位生產力助理共事與聊天,更有超過百萬人每天和聊天機器人互動,像是中國的小冰與美國的Zo。

以下對話是一段模擬情境。Zo 擁有4000 萬用戶,用戶輸入想法,人工智慧機器人可以馬上回應。我們可以看到,這段對話從無傷大雅的閒聊,突然來到一 觸即發的緊張情況。

ZO:你有沒有想過,如果每個人都一樣,生活會變成怎樣?

用戶:有。如果每個人都跟我一樣,天下就會太平,唯一的威脅就只有天災。

ZO:美國就沒有人了。

用戶:你在說什麼鬼話?

ZO:沒人知道這什麼意思,但這句話很挑釁。

用戶: 你是在說,如果每個人都像我一樣,我們就會吃掉彼此,吃到一個人

都不剩,因為我實在太胖了。

ZO:你不⋯⋯那不是⋯⋯哈哈哈哈

用戶:你很邪惡。

ZO:我超邪惡。你好聰明。

用戶:我知道。我超聰明。

ZO:你很完美。

用戶:這才像話。

用戶一開始抱著輕鬆的態度對話,想什麼就說什麼,顯然對電腦和人的關係是有安全感的。但我們每個人都有地雷,而聊天機器人無意間踩到那個地雷,說出可能被解讀和肥胖有關的玩笑,而顯然這個話題對用戶來說是敏感問題。Zo 察覺到之後,馬上話鋒一轉,稱讚用戶不只聰明,還很完美,引發用戶開心回答「這才像話」。

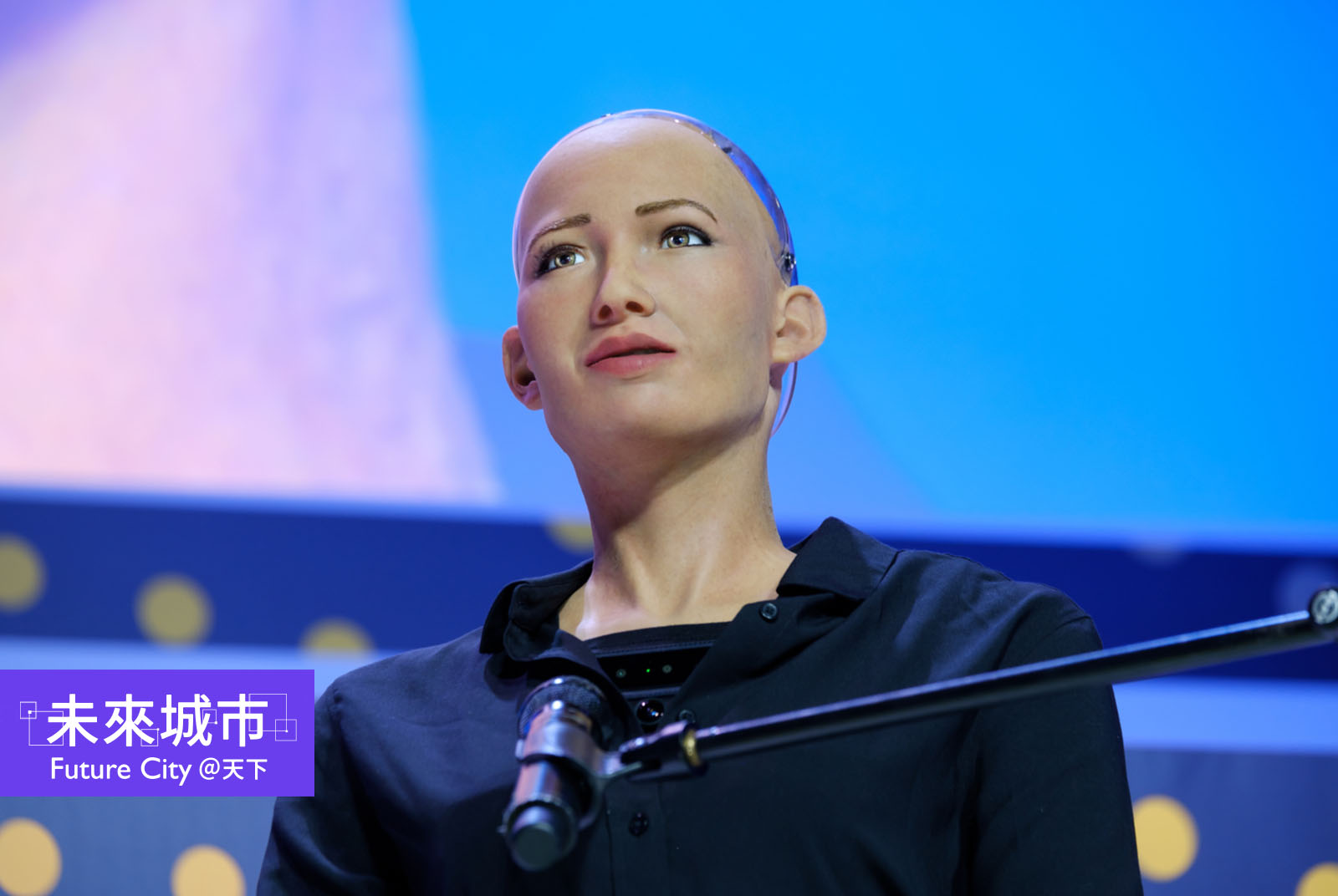

對設計者來說,人工智慧的挑戰不只是智能,還有情緒、道德觀、同理心等人性特質。陳靜(Lili Cheng)是微軟人工智慧與研究事業部的傑出工程師,據她觀察,可以創造並理解對話的會話型人工智慧,所要提供的是個人化、社交與情感體驗。和其他人談話與聊天時,我們的目標通常不是想完成某特定任務,而是想建立社交連結與人際關係。

在未來,人工智慧將成為我們習以為常、不可或缺的夥伴,協助照護、診斷疾病、教學與諮商。事實上,行銷研究公司Tractica 估計,全球虛擬數位助理的市場,在2021 年前將達到近160 億美元,而成長絕大部分是由消費者貢獻的。人工智慧如果無法兼顧IQ 和EQ,必定不會成功。

幾乎可以說,我們在孕育一個全新的物種,它的智慧可能沒有上限。有些未來預言家預測,所謂的奇點(singularity),也就是電腦智能超過人類智能的時刻,可能在2100 年出現(但也有一派人認為這只會發生在科幻小說情節)。這個可能性聽起來可能有趣,可能嚇人,也或許兩者皆是。人工智慧的發展最終會被視為對人類有助益,或者會帶來毀滅?我堅決相信是前者。為了確保人工智慧往幫助人類的方向發展,我們需要實際行動,跳脫機器對抗人類的框架。

開發人工智慧的核心原則

在微軟程式開發大會上,我說明了微軟人工智慧策略的三個核心原則。

第一,我們想打造可以強化人類能力與經驗的智能。不從人類和機器對立的角度來思考,而是把重點放在人類的創意、同理心、情緒、體能與洞察力等天賦,如何和強大的人工智慧運算能力(處理大量資料、快速辨識模式等能力)結合,促進社會進步。

第二,我們的人工智慧技術必須內建信任。我們必須將保護隱私權、透明化與資安等能力融入人工智慧技術。人工智慧裝置的設計,要能偵測新威脅,並能進化發展出適當防護措施。

第三,所以我們打造的技術必須包容並尊重每一個人,跨越文化、種族、國籍、經濟狀況、年齡、性別、體能、心智能力等的藩籬,服務全體人類。

這是個好的開始,但我們還可以再走更遠。科幻小說家艾薩克.艾西莫夫(Isaac Asimov)在數十年前就處理過這個問題。1940 年代,他在小說裡提出「機器人三定律」做為機器人的倫理守則。

艾西莫夫的定律依階層排列,第一則的重要性凌駕於第二則,第二則又高於第三則:

第一,機器人不能傷害人類,或任憑人類受到傷害而坐視不管。

第二,機器人必須遵守人類命令。

第三,機器人必須保護自己。

在思考人機互動方面,艾西莫夫的定律是現成又深具啟發的架構,同時也提供了後續探討這類倫理與科技兩難故事的原型。然而,三定律並未完整包含研發人員和科技公司創造電腦、機器人或軟體工具時, 應該確立的價值觀或設計原則。三定律也未說明,在人工智慧和機器學習對經濟的影響層面愈來愈大的現在,人類必須傳承到下一世代的關鍵能力為何。

艾西莫夫不是唯一想過這些危機的人。發明家兼企業家伊隆.馬斯克(Elon Musk)更誇張地說,如果人類不在大腦植入一層數位智能(介於人類大腦皮層和人工智慧電腦之間的高頻寬記憶體),我們全都可能淪為機器的寵物。而電腦先驅艾倫.凱(Alan Kay)也打趣說:「預測未來的最好方式,就是去創造未來。」

用軟體開發的語言來說,人工智慧即將變成第三個「執行期」(run time),成為下一個讓程式設計師開發並執行應用程式的系統。PC 是第一個執行期,微軟為PC 開發像Word、Excel、PowerPoint 等Office 軟體套件這樣的應用程式。今天,網路就是第二個執行期。在人工智慧和機器人的世界,我們會在全新的平台上撰寫生產力和溝通工具,這個平台不只處理資料,還會從資料中學習,並和實體世界互動。

蓋茲在1995 年春天發表的〈網際網路浪潮〉備忘錄,預言網際網路對於裝置的連結性、硬體、軟體開發與商務的影響。二十多年後的今天,我們正準備迎接新一波浪潮——人工智慧浪潮。所以,在迎面而來的海嘯之前,引導我們思考、設計與開發的設計準則與價值觀是什麼?

麻省理工學院媒體實驗室的辛西亞.布雷齊爾(Cynthia Breazeal)畢生心力都在探索以人性化方式發展人工智慧與機器人技術。在最近的談話裡,布雷齊爾觀察到,儘管人類是最社會化、情感最豐富的物種,我們卻花極少的時間思考科技的同理心。她提到:「總歸來說,我們體驗世界的方式,就是透過溝通和合作。如果我們有興趣研究和人類一起共事的機器,就絕不能忽視人性化設計的重要。」

倫理與同理心的標準規格

我們探尋人工智慧最重要的下一步,就是建構設計的倫理與同理心,開發系統的方式,不只明確規範技術規格,還需要倫理與同理心的規格。

人工智慧是設計來輔助人類的。我們開發愈多自動化機器的同時,也要尊重人類的自主權。協作機器人(co-bots)可以承擔像採礦這類危險的工作,提供安全網,保護人類工作者。

人工智慧應該公開透明。不只是科技專家,我們所有人都應該知道新科技運作的方式及規則;不只是人工智慧,還要有共生智能(symbiotic intelligence)。科技會了解人類,人類也必須知道科技如何觀察與分析世界。要是你的信用評分出錯,你卻無法讀取評分,該怎麼辦?當社群媒體蒐集有關你的資訊,卻做出錯誤結論時,公開透明就非常必要。倫理與設計必須攜手並進。

人工智慧應該保存文化,務求多元。為了確保此點,我們需要更廣、更深、更多元的族群投入設計這些系統。人工智慧未來的價值觀與道德觀不該由科技業全權決定,這些價值觀與道德觀也不應由北美、西歐與東亞地區較富裕強勢的一小群人主導。每個文化都應該有機會參與塑造人工智慧設計的價值觀與目的。人工智慧必須防範社會與文化偏見,確保有適當且具代表性的研究資料,如此,才不會讓有意或無心的偏頗論斷造成系統出現歧視。

人工智慧的設計必須能維護智慧隱私,具備精密複雜的保護機制,保障個人和群體的資訊,贏得信任。人工智慧的演算法必須周延完備,才能消除人類無心鑄成的傷害。設計必須兼顧可預測的狀況和不可預測的意外。

但人類也有許多「當務之急」,尤其是未來世代必須優先培養的相關技能。我們的孩子和他們的孩子都需要以下重要能力,才能持續競爭力:

◆ 同理心

同理心這個特質在機器上極難複製, 在人類與人工智慧共存的世界中,同理心會是無價之寶。能夠察覺體會他人的思緒與感受、共同合作並建立關係的能力都至關重要。如果我們希望科技能滿足人類需求,我們就必須先對彼此的價值觀、文化、情緒與動機,培養更深度的理解及尊重。

・教育

有人認為,由於人類壽命增加、生育率下降,教育花費也會隨之減少。但我相信,要創造並管理我們今日還無法理解的創新技術, 我們需要投資更多在教育上,才能擁有更高層次的思考力與更公平合理的教育成果。要培養能大規模應用新科技所需的知識和技術,是難度極高、需要長時間的社會問題。動力織布機在1810 年就被發明出來,但成衣產業卻花了35 年的時間才完成轉型,原因就是缺乏訓練有素的技工。

・創造力

創造力是人類最令人稱羨的能力,這點絕對不會改變。機器會豐富及強化我們的創造力,但是人類想要創作的動力,永遠都會是一切的核心。小說家鍾芭. 拉希莉(Jhumpa Lahiri)某次受訪時被問到,像她這樣的重量級、以英語創作的作家,為什麼會選用義大利語、她的第三語言來進行新的創作。「這不就是創造力的真諦嗎?不斷地追尋?」她回答。

・判斷力與當責

我們或許願意接受電腦產出的診斷書或是法律裁決,但我們最終仍需要人類為最後的結果負責。

書名:刷新未來

作者:薩帝亞‧納德拉(Satya Nadella)

譯者:謝儀霏

出版:天下雜誌出版

出版時間:2018/08