「台灣人工智慧實驗室」與《天下》合作,透過AI,讓天下雜誌影視中心總監李洛梅的「孿生聲音」——「Sky」為你朗讀文章,聽起來宛如真人發聲。

AI與聲音應用有哪些可能?背後隱藏哪些危機?未來城市邀請聲音主人李洛梅與台灣人工智慧實驗室杜奕瑾共談合作的想像與經驗。

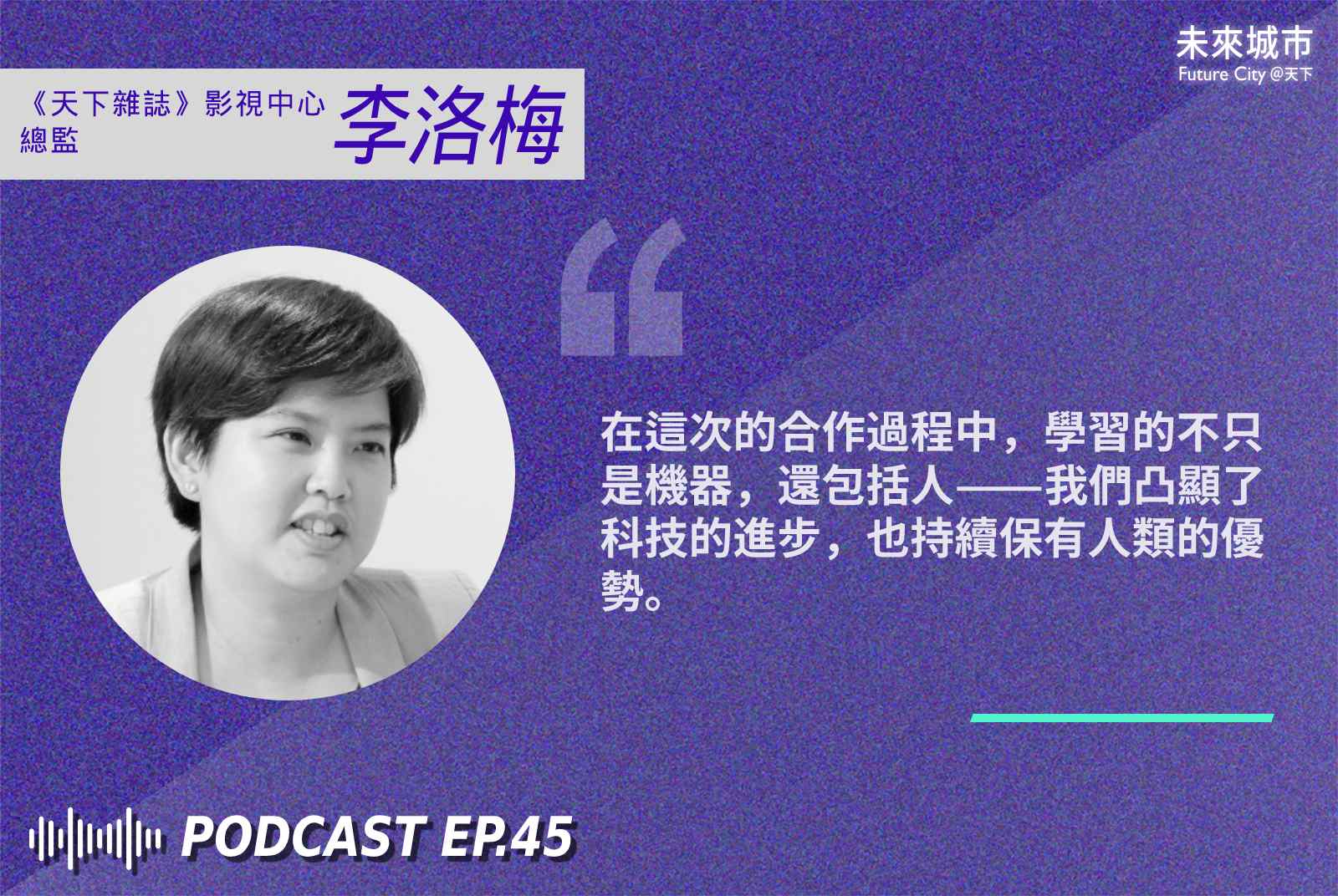

未來城市Podcast EP.45

▹ 未來主持人:未來城市頻道總監陳芳毓

▹ 未來大來賓:台灣人工智慧實驗室創辦人杜奕瑾、天下雜誌影視中心總監李洛梅

▹ 訪談精華一次收藏:

杜奕瑾認為,判斷真假消息時,可從散播方式判別消息的可信度。圖片製作:未來城市編輯部

杜奕瑾認為,判斷真假消息時,可從散播方式判別消息的可信度。圖片製作:未來城市編輯部

李洛梅認為,人機共學將成為未來趨勢。圖片製作:未來城市編輯部

李洛梅認為,人機共學將成為未來趨勢。圖片製作:未來城市編輯部

Q:為什麼「聽天下」和「台灣人工智慧實驗室」合作推出Sky文章朗讀服務?

李洛梅(以下簡稱李):2019下半年,《天下》開始經營Podcast頻道「聽天下」。其實,《天下》網站和APP更早之前,就推出機器人朗讀文章服務。不過當時技術不夠成熟,很多讀者覺得機器的聲音非常冰冷,聽起來不舒服;因此影視中心開始討論,要不要乾脆讓真人來錄,而成立了「聽天下」。

現在,我們希望做得更好,所以回到創新的源頭,繼續優化語音朗讀服務。相信長期使用的讀者會發現,我們現在的技術已跟過去非常不一樣。我覺得這是很有趣的經驗,因為這是人跟機器在一年裡不斷協作的過程。

杜奕瑾(以下簡稱杜):Taiwan AI Labs(台灣人工智慧實驗室)在2017成立後,先從人機互動著手,推出了第一個以台灣語音、語料為主的語音辨識APP「雅婷逐字稿」。雖然雅婷在台灣,已有上得了檯面的語音辨識和生成能力,但我們發現,它生成的語音跟專業的廣播、電視所需要的聲音仍有差距。後來,我到《天下》錄製Podcast節目,所以就想向《天下》學習專業播報者的聲音。

Q:你們如何做出AI語音Sky的文章朗讀功能?

李:《天下》是內容提供者,我們提供Taiwan AI Labs團隊五個小時我的音檔,再加上完全對照的稿件,讓他們學習。

杜:AI通常都有一個預訓練模型(pre-trained model),也就是已經聽過很多語音、語料,也已經知道怎麼講話的模型。所以,拿到洛梅的聲音後,我們再讓它聽、學習洛梅如何講話。

Q:合作過程中,最大的挑戰是什麼?

李:由於Podcast是全真人聲音的環境,聽眾對聲音的要求度較高,且對我的聲音是熟悉的,所以我們受到了更高標準的檢驗。因此,今年八月,我們在第二頻道「闖天下」做了「AI讀新聞」節目;這也是全面擴展到《天下》官網前的測試。

當時,聽眾回饋了很多有建設性的建議,具體地指出人聲跟機器不一樣的地方——而這也是語音生成最困難之處。

例如,「寶可夢」的發音是三聲、三聲、四聲;但平常講話時,如果有兩個三聲連在一起,第一個三聲會變成二聲——這就是為什麼機器聽起來跟人聲不一樣。

所以,我們不能只是把文章丟進模板、讓AI自動生成;而要聽完AI生成的語音後,再回去重新調整文稿。像在剛剛的例子裡,有些字透過機器,聽起來不太順耳,我們就要抽換中文字,讓它聽起來更順暢;還有逗號、句號、冒號等標點符號的朗讀間隔會不太一樣。這個過程非常需要人工跟機器協作。

杜:AI學習洛梅講話的過程中,之前學的「壞習慣」,也會被帶進來。例如,破音字容易念錯;或一般人講話較不清楚的拖字、聲音模糊也會顯現。而真人講話時會有抑揚頓挫與呼吸,所以才需要標逗號、句號,讓機器說話更像真人。

過去,我們只希望生成的語音學好真人的特色,讓大家聽得懂、認得出是洛梅的聲音。但有些發音習慣,不見得用五個小時的音檔就能學成。所以,從一般語音辨識與語音合成,要做到專業播報員等級,甚至讓人無法辨識這是洛梅還是機器的聲音,中間還有一段很大差距。

Q:接下來想如何優化Sky的聲音?

李:我們正在嘗試兩個面向。第一,我們希望為Sky創造出全新、獨特的聲音,讓它的音色和音質有自己的性格,所以我們正試著把我的聲音結合不同的聲音。第二,也是我覺得比較困難的,大家現在可能覺得Sky聽起來半人半獸,雖是人聲,但有機械感,我們希望它愈來愈像人的自然表達方法。

杜:臉部生成技術已可以結合兩人的照片,預測他們的小孩長怎樣,而聲音也可以做到。比方說,剛開始釋出Sky的聲音時,有些人認為這聲音有點咄咄逼人;未來,我們可以嘗試摻入較柔軟的聲音,生成的聲音就會較舒緩。我覺得,這就是看目標要往哪走——要做跟洛梅一樣的聲音,或用想像力創造有特色的聲音,都可以調整。

Q:AI讀新聞,對於媒體的未來有什麼影響?

李:雖然,我們不是因為缺工才做AI文章朗讀,但的確可以想見,社會即將面臨人力問題;尤其現代人用眼過度,更需要用聽的方式獲得資訊。這時,就可以借用科技來補足。

但是,在Podcast的環境裡仍有真人需求;這也反映我們的社會現況——雖然科技可以彌補人力短缺,但絕對無法取代人類。所以未來,我們要習慣的是人跟機器合作,而我們現在就是在做這樣子的練習。

我常想到一句話:「科技始終來自於人性。」在這個合作過程中,學習的不只是機器,還包括人;我們凸顯了科技的進步,也持續保有人類的優勢。

接下來,我們也想擴大、精進聲音服務,包含真人Podcast節目,和在官網、APP上推出AI機器人共同學習產生的產品。

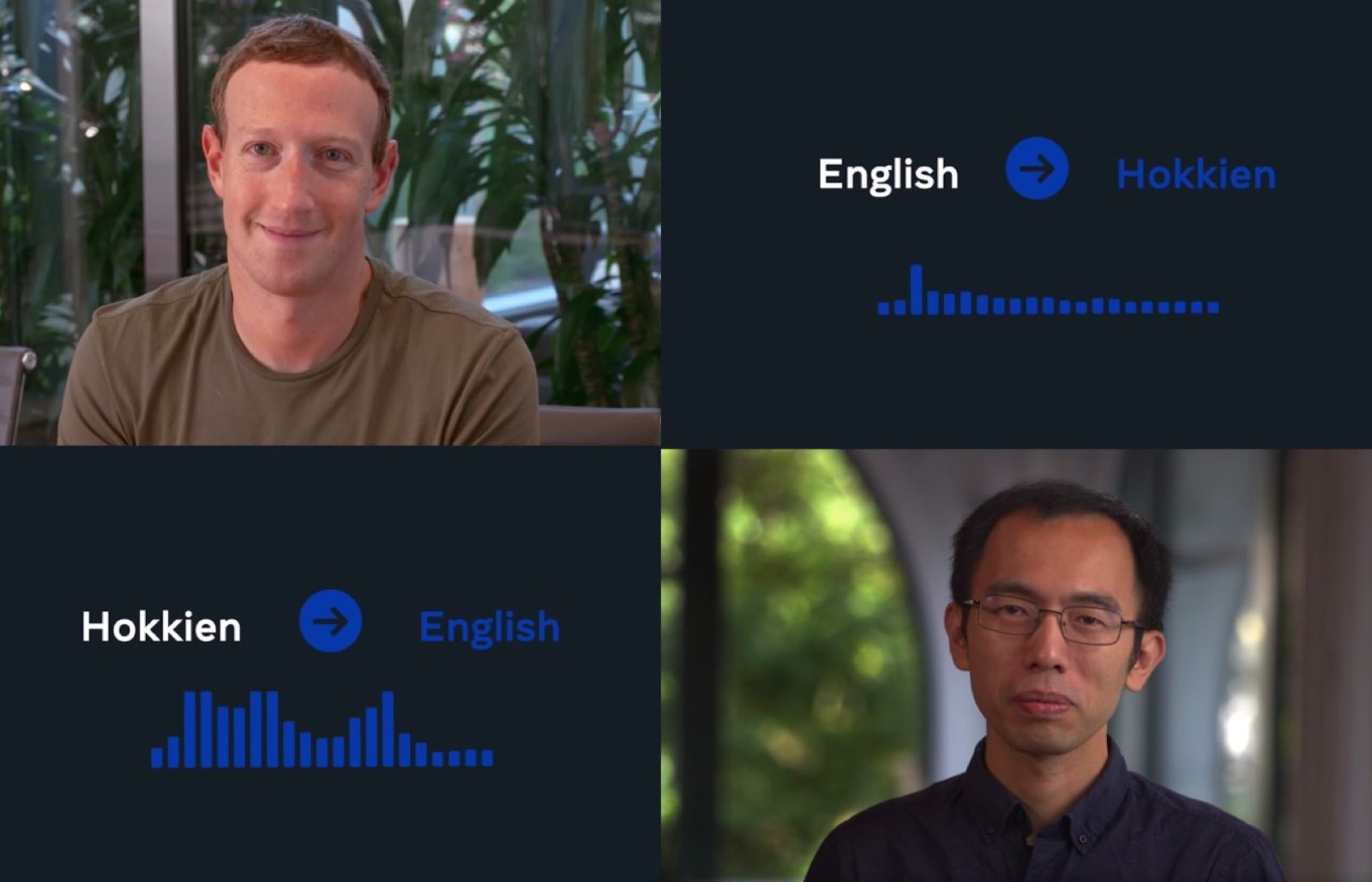

Q:之前,Meta釋出一項新服務,能對照翻譯閩南語和英語語音,開發者是來自台灣的工程師陳鵬仁。台灣人工智慧實驗室也有類似的服務?

日前Meta釋出新的語音服務,能對照翻譯閩南語和英語語音。圖片來源:截自Mark Zuckerberg臉書

日前Meta釋出新的語音服務,能對照翻譯閩南語和英語語音。圖片來源:截自Mark Zuckerberg臉書

杜:台語的語音辨識、生成是相對困難的,因為這個語言並沒有文字。2017年,科技部的「科技大擂台:與AI對話」計畫,其中一項任務就是搜集台灣的台語、台灣國語、台式英語、原住民語與客家語。蒐集後,就能訓練台灣的語音辨識及生成。因此,兩年多前,雅婷逐字稿有了台語的語音辨識,也能將辨識結果翻成英文。

Q:科技有一個恐怖谷理論——看到很像真人的機器人,卻又有一點不太像人的細節時,會有種詭異的感覺。你們合作時,有沒有這種感覺?

李:第一時間聽到音質、音色跟我很像的聲音時,先覺得「額!有點噁心!」(笑);第二個反應則是「好可怕」,因為它不過拿了我五個小時的聲音與文件,就做出與我類似的聲音,不熟悉我的人可能還會覺得,這就是我的聲音。

這讓我想到,現在我們有deepfake(深偽技術),而聲音也是生物辨識的一環;所以,聲音的安全、類似肖像權概念,也會是未來資安的重要議題。

Q:當AI與聲音的應用越來越多,該何防範語音合成技術的濫用?

杜:最近,有很多deepfake的科技倫理討論。長久以來,生物特徵是我們辨識人的方式;例如聽到某個聲音就覺得是媽媽的聲音,看到某張臉就知道是誰。但是,deepfake可以精準模仿人臉與聲音,導致很常有人被誤導。

雖然,有些人在研究如何破解deepfake,但這其實很難從內容本身判斷真假。因為,deepfake的訓練過程就是對象式學習——拿一個能辨識真假的對象去訓練、合成,有心者會把它加入訓練,直到可以騙過辨識為止。也就是說,它只會越來越真;就算我們找出辨識方法,它被科技化後,就會成為對象式學習的一環。

所以,我們需要思考的是怎麼防止類似機制。例如,法規上,不管是人類的肢體動作、表情、聲音都能被模仿,那肖像權到底是什麼?

有關訊息操作的研究,我們很難判斷訊息真假,事實查核也需要花時間。所以,現在大部分虛假消息的判斷,是從使用者行為模式著手——從消息散播方式來判斷消息來源是否可靠。這也是為什麼現在社群媒體,對廣告、演算法透明度,有越來越多要求,就是因為很難從內容本身去看真假,且牽涉到審查界線的問題。

聽懂未來:關於科技應用,我還想知道更多⋯⋯

未來城市給你更多知識補充包!

- 最熟陳時中與劉寶傑聲音的AI!陽明交大團隊:肯蹲低,才精準

- 紅白歌合戰AI復活過世30年「歌謠女王」美空雲雀 有人嚇傻有人哭

- 從金鐘獎看台灣AI發展!《下一步,AI。Next,愛》用到哪些人工智慧?

- 僅頸部以下是真的!紀錄片導演用「AI替身」 同性戀難民不出櫃也能控訴政府

想聽更多未來城市Podcast節目?

- 首播時間:隔週六上午播出。

- 頻道搜尋:天下雜誌Podcast頻道「聽天下」,或關注未來城市網站「未來城市Podcast」系列內容。